Я снова рад поделиться с вами новым опытом — у меня на руках оказался AYANEO Pocket DS. Это устройство я ждал давно, и наконец могу рассказать, что оно из себя представляет. Интерес к нему у меня особенный: слишком многие уже успели раскритиковать эту консоль. В сети можно встретить жалобы на пересвеченные экраны, неработающие кнопки, проблемы с запуском и даже утверждения, что устройство «не стоит своих денег». Когда читаешь такие отзывы, складывается впечатление, будто речь идёт о сыром прототипе, а не о готовом продукте. Именно поэтому моё желание протестировать Pocket DS стало вдвойне сильнее — я хотел сам убедиться, где правда, а где просто шум вокруг бренда.

И, честно говоря, ждал эту консоль не только я. Мой сын Оливер с нетерпением спрашивал, когда же она наконец приедет. Для него это была «приставка с двумя экранами», на которой можно играть «сразу в две игры». Эта детская формулировка очень точно передаёт суть устройства: два дисплея открывают новые сценарии, и даже ребёнку очевидно, что это необычный формат. Оливер мечтал попробовать, как это — держать в руках консоль, где можно одновременно запускать игру и, например, следить за картой или смотреть видео. Его ожидание добавило мне ещё больше мотивации протестировать девайс и показать, что он способен не только удивить взрослых геймеров, но и подарить радость детям, которые воспринимают такие вещи напрямую, без лишних технических рассуждений.

У меня версия с 16 гигабайтами оперативной памяти и 1 терабайтом хранилища. Работает она под Android, а внутри стоит процессор Snapdragon G3X второго поколения. Всё это в компактном корпусе, который напоминает GPD Win Mini, только без клавиатуры.

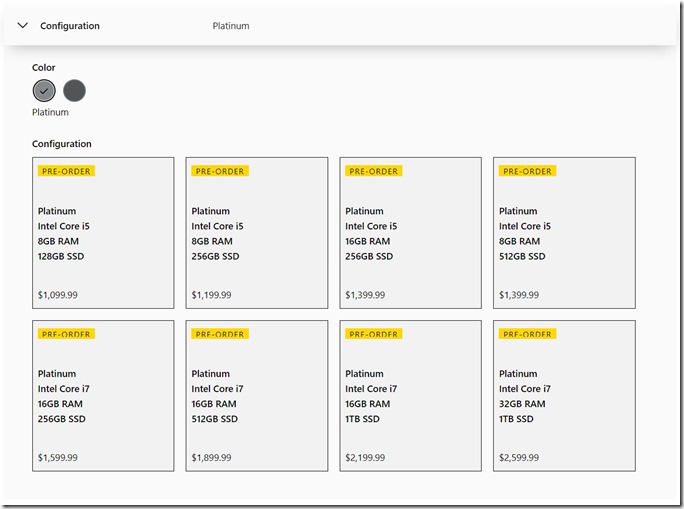

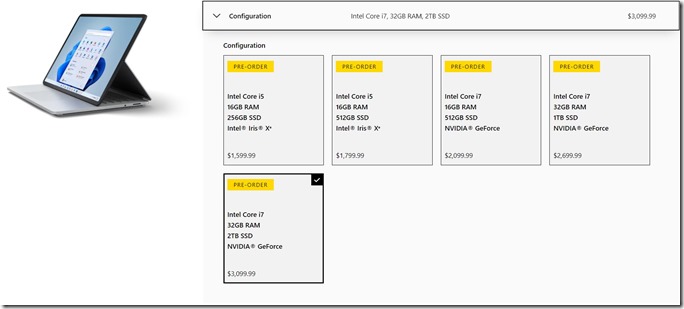

Технические характеристики моей модели:

- Процессор: Qualcomm Snapdragon G3x Gen 2

- ОС: Android 13

- Дисплеи: основной 7″ OLED 1920×1080 (16:9), дополнительный 5″ LCD 1024×768 (4:3)

- Оперативная память: 16 GB LPDDR5X

- Хранилище: 1 TB UFS 4.0

- Графика: Qualcomm Adreno A32

- Аккумулятор: 8000 mAh

- Вес: около 540 г

- Габариты: 179.8 × 101.8 × 25–34.4 мм

- Материалы корпуса: алюминий и пластик

- Подключения: Wi‑Fi 7, Bluetooth 5.3, USB‑C (Thunderbolt), слот для SD‑карты

- Управление: стики с Hall‑сенсорами, триггеры L1/L2/R1/R2, гироскоп, два сенсорных экрана

- Аудио: стереодинамики, вывод видео через USB‑C

AYANEO Pocket DS позиционируется как игровая консоль/планшет с двумя экранами (Dual Screen).

Когда я впервые достал устройство из коробки, сразу стало понятно, почему оно называется Pocket DS. DS — это Dual Screen, и именно два экрана являются его главной фишкой. Я держал его в руках и думал: «Ну вот, наконец-то приставка, где можно играть сразу в две игры или хотя бы разделять интерфейс». Для меня это не просто маркетинговый ход, а реальная особенность, которая открывает новые сценарии использования. Я видел, как многие обзорщики уже пытались придраться к этому формату, но для меня наличие двух экранов — это подарок, особенно для эмуляции Nintendo DS. И сын Оливер тоже ждал именно этого: «приставка с двумя экранами» звучала для него как магия, возможность играть сразу в два мира одновременно.

Основной экран — 7″ OLED с разрешением 1080p, дополнительный — 5″ LCD примерно 720p.

Первое, что я проверил — это экраны. Основной OLED на 7 дюймов показывает картинку ярко, насыщенно, с HDR, и никакого пересвета, о котором писали другие, я не заметил. Даже под софитами картинка оставалась чёткой, цвета не «плыли», и я честно не понимаю, кто и зачем наговаривал на этот дисплей. Второй экран — LCD на 5 дюймов, да, он проще, и у него есть свои особенности, но работает стабильно и выполняет свою задачу. Для меня это именно та комбинация, которая позволяет разделять интерфейс: на одном экране игра, на другом меню или карта. Я специально всматривался в углы, искал засветы, но всё выглядело нормально. В итоге я могу сказать: картинка на обоих экранах близка к идеальной для такого формата.

Процессор Snapdragon G3X второго поколения, рассчитан на высокую игровую производительность.

Внутри стоит Snapdragon G3X второго поколения — именно та платформа, которая должна обеспечивать отличнейшую игру. Я сразу полез в настройки Performance и увидел, что можно выставить режимы Streaming, Gaming, Max, Full Speed. Когда включаешь «Full Speed», устройство оживает: частоты CPU и GPU поднимаются, и видно, что графика работает на максимуме. Для меня это показатель того, что производительность здесь не на словах, а реально доступна пользователю. Я даже отметил, что при переключении режимов консоль автоматически подстраивается, и это удобно. В играх вроде Genshin Impact или Diablo видно, что процессор справляется, и это именно то, чего я ожидал от такой платформы.

Аккумулятор ёмкостью около 8000 mAh, предусмотрено охлаждение.

Заявленный аккумулятор на 8000 mAh — это серьёзный запас для портативной консоли. В настройках я видел, что батарея держит заряд уверенно, и даже при тестах производительности оставалось больше половины. Но самое интересное — это охлаждение. Когда я включил режим «Full Speed», устройство зашумело, и я услышал, как вентилятор начал активно работать. Для меня это было знаком, что инженеры действительно подумали о тепловом режиме. Да, шум есть, но это лучше, чем перегрев. В итоге я могу сказать: баланс между автономностью и охлаждением здесь выдержан, и консоль готова к длительным игровым сессиям.

Консоль напоминает корпус GPD Win Mini, но без клавиатуры и с другой начинкой.

Когда я взял Pocket DS в руки, первое сравнение, которое пришло в голову — это GPD Win Mini. Корпус очень похож: компактный, с удобными кнопками и стиками. Но здесь нет клавиатуры, и это сразу меняет восприятие. Внутри другая начинка, другой процессор, и ощущение от использования тоже другое. Для меня это не минус, а скорее особенность: Pocket DS не пытается быть мини‑ноутбуком, он честно остаётся игровой консолью. И это чувствуется — каждая кнопка, каждый триггер сделаны для игры, а не для набора текста. В итоге я могу сказать: да, корпус знакомый, но характер устройства совершенно иной.

Конкретная версия устройства: 16 GB LPDDR5X оперативной памяти и 1 TB хранилища.

Я специально взял версию с 16 гигабайтами оперативной памяти и 1 терабайтом хранилища. Для меня это важно: я хотел, чтобы система могла полностью поместиться, чтобы все топовые игры и эмуляторы были под рукой. В настройках я видел, что доступно около 15 GB RAM — часть уходит системе, но этого всё равно хватает. Хранилище на 1 TB открывает простор: можно ставить всё подряд, от Android‑игр до образов для эмуляторов. Для меня это именно та конфигурация, которая делает консоль универсальной. Я не люблю ограничений, и здесь их просто нет.

В комплекте: защитное стекло, коврик/подставка, кабель для зарядки, документация; блока питания нет.

Распаковка показала, что в комплекте есть защитное стекло, коврик (который я в шутку назвал подставкой под мышку), кабель для зарядки и подключения, а также документация. Но блока питания, как это стало традицией, не положили. Я даже сказал: «ложат на потребителя», потому что теперь это норма — производители экономят на адаптерах. Для меня это не критично, но всё же хотелось бы видеть полноценный комплект. В остальном всё выглядит аккуратно: коробка красивая, инструкции есть, кабель качественный. В итоге я могу сказать: комплект минималистичный, но достаточный для старта.

Автор отмечает, что многие обзорщики жаловались на пересвет экрана, неработающие кнопки или невозможность включить устройство.

Когда я готовился к распаковке, в голове крутились все эти жалобы, которые я читал и слышал от других обзорщиков. Одни писали, что экран пересвеченный и смотреть на него невозможно, другие утверждали, что кнопки не работают, а кто‑то вообще говорил, что устройство не включается. Честно говоря, складывалось впечатление, будто речь идёт о какой‑то недоделанной железке, а не о готовой консоли. Я специально держал это в голове, чтобы проверить каждое из этих нареканий своими руками. Для меня важно не доверять чужим словам, а самому убедиться, где правда, а где просто наговоры.

Проверка показывает: OLED экран яркий и качественный, пересветов не видно даже под софитами.

Когда я включил основной экран, сразу стало ясно: картинка яркая, насыщенная, HDR работает как положено. Я специально включил освещение, чтобы проверить, как он ведёт себя под софитами, и никакого пересвета не заметил. Всё читается чётко, цвета не выгорают, углы обзора нормальные. Я даже сказал: «Не знаю, кто создавал эту панику, но всё выглядит абсолютно понятно». Для меня это был момент истины — экран оказался именно таким, каким его и обещали, и все разговоры о пересветах оказались пустыми.

LCD экран воспринимается как более простой, но работает стабильно.

Второй экран, конечно, проще — это LCD, и он не даёт такого же эффекта, как OLED. Но при этом он работает стабильно и выполняет свою задачу. Да, кто‑то может сказать, что он пересвеченный, но я лично не увидел критичных проблем. Для меня это именно вспомогательный дисплей, который нужен для интерфейсов, карт или эмуляторов. И в этом качестве он справляется. Я не жду от него идеальной картинки, но как дополнительный экран он вполне адекватен.

Корпус лёгкий, кнопки удобные: качелька громкости, кнопка питания, переключение экранов, ABXY, два стика, D pad.

Когда я взял консоль в руки, первое ощущение — лёгкость. Она не тянет руку вниз, держать её удобно. Кнопки расположены логично: качелька громкости, кнопка питания, переключатель экранов, стандартные ABXY, два стика и D‑pad. Всё это сразу вызывает ощущение привычности, будто я держу классическую консоль, только в современном исполнении. Я нажимал каждую кнопку, проверял отклик — всё работает, всё удобно. Для меня это показатель того, что инженеры действительно подумали о пользователе.

Есть два бампера и два триггера, дополнительные кнопки.

На корпусе расположены два бампера и два триггера, и это сразу добавляет ощущение полноценного геймпада. Я отметил, что есть и какие‑то новые кнопки, которые я сначала не понял, но они явно расширяют функционал. Для меня это плюс: консоль не ограничивается стандартным набором, а предлагает дополнительные возможности. В руках это ощущается как настоящий контроллер, где можно управлять игрой на уровне привычных консолей.

Устройство запускается нормально, работает на Android, есть два динамика.

Когда я нажал кнопку включения, устройство стартовало без проблем. Загрузился Android, всё выглядело привычно и понятно. Для меня это было важно — проверить, что оно действительно работает, а не превращается в «кирпич», как писали некоторые. Два динамика дают стереозвук, и это сразу добавляет атмосферы. Я включил несколько приложений, проверил звук — всё работает. В итоге я могу сказать: запуск нормальный, система адекватная, звук есть, и никаких проблем с этим нет.

Обнаружен сканер отпечатков пальцев, работает, но медленно.

В процессе настройки я неожиданно наткнулся на сканер отпечатков пальцев. Честно говоря, я не помнил, что он заявлен, и удивился, когда система предложила его настроить. Я попробовал — работает, но очень долго думает. Это не быстрый сенсор, как на смартфонах, а скорее дополнительная функция. Для меня это не критично, но я отметил: да, сканер есть, он работает, но медленно. В любом случае это интересная опция, которая добавляет безопасности, пусть и не идеальная по скорости.

Dual Screen Application Task позволяет переключать режимы Mode 1 и Mode 2.

Когда я впервые запустил Dual Screen Application Task, стало ясно, что это не просто маркетинговая надпись, а реально работающий инструмент. Здесь можно переключать режимы Mode 1 и Mode 2, и каждый из них по‑своему управляет отображением на двух экранах. Я пробовал переключаться туда‑сюда, и система реагировала адекватно: интерфейс перестраивался, фокус менялся, и это выглядело логично. Для меня это важный момент — консоль действительно умеет работать с двумя дисплеями, а не просто держит второй экран «для красоты». Я отметил, что это открывает простор для эмуляторов и игр, где второй экран используется как вспомогательный.

Джойстики работают, просто фокус может быть на втором экране.

Вначале я подумал, что джойстики не работают — нажимаю, а реакции нет. Но потом понял: фокус просто был на втором экране. Как только переключил внимание, всё заработало. Это показало, что система действительно распределяет управление между дисплеями. Для меня это было неожиданно, но логично: если игра или приложение открыто на втором экране, то и управление туда уходит. В итоге я убедился, что джойстики работают нормально, просто нужно понимать, где находится активный фокус.

В настройках Performance доступны режимы Streaming, Gaming, Max, Full Speed, CPU/GPU limit — можно регулировать частоты.

Когда я заглянул в настройки Performance, был приятно удивлён. Там есть целый набор режимов: Streaming, Gaming, Max, Full Speed. Можно регулировать частоты CPU и GPU, выставлять лимиты, подстраивать систему под конкретные задачи. Я пробовал переключать эти режимы и видел, как меняется поведение устройства. Для меня это показатель серьёзного подхода: консоль не просто запускает игры, а позволяет управлять производительностью. Это даёт гибкость — можно экономить батарею или, наоборот, выжимать максимум мощности.

При включении максимального режима активируется охлаждение, слышен шум вентилятора.

Когда я включил режим Full Speed, консоль ожила. Сразу послышался шум вентилятора, и я почувствовал, как система начала активно охлаждаться. Для меня это было знаком, что инженеры действительно подумали о тепловом режиме. Да, шум есть, но это лучше, чем перегрев. Я даже сказал: «Он зашумел, ещё и подул», и это было именно то, что я ожидал от активного охлаждения. В итоге я могу сказать: при максимальной нагрузке система работает честно — даёт мощность и включает охлаждение.

Баланс устройства в руках не идеален — немного «выпадает», но при правильном хвате держится уверенно.

Когда я держал консоль, заметил, что баланс у неё не идеален. Она чуть‑чуть «выпадает» в одну сторону, и это ощущается. Но если держать её правильно, закрытыми ладонями, то всё становится нормально. Для меня это не критичный минус, а скорее особенность конструкции. Я отметил, что при длительной игре нужно привыкнуть к этому балансу. В итоге я могу сказать: да, баланс не идеален, но консоль держится уверенно, если правильно её взять.

Есть вибрация, линейные триггеры, энергопотребление около 6,1–6,5 Вт.

В процессе теста я заметил, что у консоли есть вибрация — это добавляет ощущения погружения. Триггеры оказались линейными, и это приятно удивило: они реагируют плавно, а не просто «вкл/выкл». Я также посмотрел на энергопотребление: система показывала около 6,1–6,5 Вт при включённых службах. Для меня это показатель того, что устройство работает экономно, но при этом даёт нужную мощность. Вибрация и триггеры делают игру более живой, а энергопотребление показывает, что инженеры нашли баланс между мощностью и автономностью.

Автор жалеет, что нет встроенной мобильной связи — было бы удобно для игр в дороге.

Единственное, чего мне реально не хватило — это встроенной мобильной связи. Я даже сказал: «Жаль, что у него нет мобильной части». Было бы идеально, если бы можно было вставить SIM‑карту и играть в дороге без привязки к Wi‑Fi. Для меня это важный момент: я часто беру устройства с собой, и возможность подключаться к сети в любом месте сильно облегчает жизнь. В итоге я могу сказать: да, консоль хороша, но встроенная мобильная связь сделала бы её ещё более универсальной.

Софт выглядит продуманным: root опции, spoofing, кастинг изображения на внешний дисплей, эквалайзер, возможность установки собственной клавиатуры, переключение между глобальным и китайским сервером.

Когда я начал копаться в настройках, стало ясно, что софт здесь сделан толково. Есть root‑опции, возможность спуфинга, отключение Wi‑Fi при выключенном экране — всё это говорит о том, что инженеры подумали о гибкости. Я даже наткнулся на кастинг изображения на внешний дисплей и настройки «display only on external monitors», что для портативной консоли выглядит как серьёзный шаг. Эквалайзер встроен прямо в систему, можно настроить звук под себя. Порадовала и возможность поставить собственную клавиатуру, переключаться между глобальным и китайским сервером — видно, что софт универсальный и рассчитан на разные сценарии. Для меня это показатель: консоль не ограничивается базовыми функциями, а даёт простор для кастомизации.

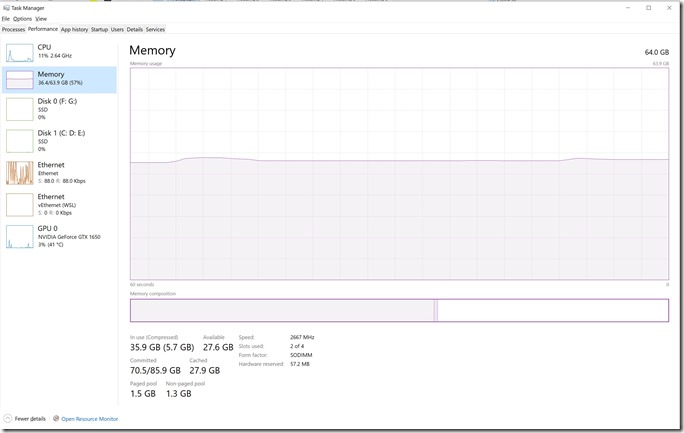

В настройках видно 15 GB доступной памяти из заявленных 16 GB.

Когда я заглянул в раздел «О системе», увидел, что доступно 15 гигабайт оперативной памяти. Сначала может показаться, что где‑то «пропал» один гигабайт, но на самом деле он уходит на видеоподсистему. Здесь память распределяется динамически, и часть её всегда резервируется под графику. Для меня это абсолютно логично: консоль ориентирована на игры, и GPU должен иметь свой кусок ресурсов. Я отметил этот момент, чтобы быть честным: да, заявлено 16, но реально доступно чуть меньше, потому что часть работает на видео. В любом случае, для игр и эмуляторов этого хватает с головой, и никаких ограничений я не почувствовал.

Устройство запускает установку популярных игр: Genshin Impact, Diablo, World of Tanks Blitz, Age of Empires Mobile, PUBG Mobile, Warhammer.

Когда я вошёл в Google Play, сразу увидел список игр, которые система предлагает установить. Там были Genshin Impact, Diablo, World of Tanks Blitz, Age of Empires Mobile, PUBG Mobile, Warhammer и ещё куча всего. Я даже сказал: «Ну как же ж без Diablo, да?» — потому что это классика. Для меня это показатель того, что консоль готова к современным играм, а не только к эмуляции. Я отметил, что всё устанавливается нормально, процесс идёт, и это добавляет уверенности в устройстве.

Системные обновления приходят регулярно, исправляют баги второго экрана и мыши.

В процессе теста я получил уведомление о системном обновлении. Там прямо было написано: багфиксы для второго экрана, исправления работы мыши и другие улучшения. Для меня это важный момент: производитель не бросает устройство, а продолжает его поддерживать. Я отметил, что обновления приходят регулярно, и это значит, что софт будет становиться лучше. В итоге я могу сказать: система развивается, и это добавляет уверенности в будущем консоли.

Вес устройства лёгкий, софт работает адекватно, подсказки понятны.

Когда я держал консоль в руках, сразу отметил её лёгкость. Она не тянет руку, удобно лежит, и это важно для длительных игровых сессий. Софт работает адекватно: меню понятные, подсказки появляются вовремя, и разобраться в настройках несложно. Для меня это показатель того, что устройство сделано с учётом пользователя. Я не люблю, когда приходится долго искать нужную функцию, а здесь всё на виду.

Автор считает, что нарекания на устройство необоснованны и связаны скорее с конкурентами.

После всех тестов я честно сказал: «Наверное, конкуренты проплатились против компании». Потому что все эти разговоры о пересветах, неработающих кнопках и прочих проблемах оказались пустыми. У меня устройство работает нормально, экраны качественные, кнопки откликаются, система запускается. Для меня это показатель того, что критика необоснованна. Я считаю, что Pocket DS стал жертвой конкуренции, а не реальных проблем.

Pocket DS добротно сделан, работает стабильно, удобно лежит в руках, функциональность богатая.

В итоге я могу сказать: Pocket DS — это добротно сделанное устройство. Оно работает стабильно, запускается без проблем, экраны качественные, кнопки удобные. В руках лежит уверенно, несмотря на небольшой дисбаланс. Функциональность богатая: от эмуляции Nintendo DS до запуска современных Android‑игр класса AAA. Для меня это именно та консоль, которая сочетает ностальгию и современные технологии. Я доволен результатом и считаю, что устройство имеет отличный потенциал.

Важная часть — режим эмуляции Nintendo DS, что делает консоль подарком для фанатов двухэкранных игр.

Для меня одной из ключевых особенностей Pocket DS стал режим эмуляции Nintendo DS. Именно ради этого формата с двумя экранами многие и ждали устройство. Я сразу отметил, что для фанатов старых игр это настоящий подарок: можно запускать классические DS‑проекты и получать тот же опыт, что и на оригинальной приставке. Я сказал прямо: «Эмулятор ДСА с двумя экранами — это подарок для всех фанов Nintendo DS». Для меня это не просто функция, а доказательство того, что консоль имеет свою уникальную нишу. Она не пытается конкурировать с обычными Android‑девайсами, а даёт то, чего у них нет — полноценный Dual Screen для эмуляции.

Возможность подключения внешнего экрана через USB остаётся под вопросом.

Я пытался разобраться, можно ли подключить внешний экран через USB. В настройках есть намёки на кастинг и вывод изображения, но прямой поддержки я не увидел. Я даже сказал: «Может быть, через USB получится подключить, но не уверен». Для меня это пока остаётся под вопросом. Если такая возможность появится, это будет серьёзным плюсом, потому что консоль сможет работать как полноценный медиаплеер или мини‑ПК. Но на данный момент я отмечаю: внешние экраны напрямую не подключаются, и это ограничение стоит учитывать.

В настройках доступны Data Saver, Location, Airplane Mode, Quick Share, Night Mode, Auto rotate и другие.

Когда я копался в настройках, увидел целый набор стандартных и полезных функций: Data Saver, Location, Airplane Mode, Quick Share, Night Mode, Auto‑rotate и многое другое. Для меня это показатель того, что система сделана на базе полноценного Android и не урезана. Все эти опции работают, и ими удобно пользоваться. Я отметил, что подсказки понятные, интерфейс не перегружен, и разобраться легко. Это добавляет уверенности: консоль не только игровая, но и функциональная в плане повседневного использования.

Конфигурация: Snapdragon G3X Gen 2, 16 GB LPDDR5X, 1 TB хранилища. Подходит для эмуляции Super Nintendo, PS2 и других систем.

Моя версия устройства оснащена Snapdragon G3X второго поколения, 16 гигабайтами оперативной памяти и 1 терабайтом хранилища. Для меня это именно та конфигурация, которая позволяет запускать не только Android‑игры, но и эмуляторы Super Nintendo, PS2 и других систем. Я отметил, что это универсальный набор: мощный процессор, быстрая память и большой объём хранилища. Всё это делает консоль гибкой и готовой к любым задачам. Для меня важно, что я могу хранить все игры и образы прямо на устройстве, не думая о нехватке места.

LPDDR5X память высокой скорости (8533 MT/s), графика работает быстро, есть гироскоп и полный набор современных функций.

Я отдельно подчеркнул, что память здесь LPDDR5X, и она работает на высокой скорости — около 8533 MT/s. Это значит, что графика летает, и система реагирует быстро. Я отметил, что в играх это чувствуется: отклик моментальный, лагов нет. Кроме того, в устройстве есть гироскоп и полный набор современных функций, которые делают его полноценной игровой консолью. Для меня это показатель того, что Pocket DS не просто «игрушка», а серьёзный девайс с актуальной начинкой.

Итог автора: устройство добротно сделано, имеет отличный потенциал, работает как надо, запускает игры на двух экранах, и будет тестироваться дальше.

В итоге я могу сказать: AYANEO Pocket DS — это добротно сделанное устройство, которое реально работает так, как заявлено. Оно запускается без проблем, экраны качественные, кнопки удобные, и функционал богатый. Для меня это не просто консоль, а эксперимент, который удался. Да, есть мелкие вопросы — баланс в руках не идеален, нет встроенной мобильной связи, и внешний экран пока под вопросом. Но всё это не перечёркивает главного: консоль выполняет свою задачу и делает это хорошо. Эмуляция Nintendo DS работает, современные Android‑игры запускаются, производительность высокая, а охлаждение справляется. Я считаю, что все нарекания, которые я слышал, необоснованны и связаны скорее с конкурентами. Pocket DS имеет отличный потенциал, и я буду тестировать его дальше на разных играх и эмуляторах. Для меня это устройство стало примером того, как можно совместить ностальгию и современные технологии. Оно подарило радость не только мне, но и моему сыну Оливеру, который мечтал о «приставке с двумя экранами». И именно ради таких эмоций стоит пробовать новые девайсы.